HealthOS в горизонте 2024-2030 годов. В статье рассматривается влияние ИИ на экономику и общество на ближайшие шесть лет. Рассматриваются три аспекта: эволюция качества исполнения научно-исследовательских и опытно-конструкторских работ (НИОКР), эволюция результатов работы ИИ и доверия этим результатам, а также эволюция рисков правообладателей результатов интеллектуальной деятельности (РИД) и других нематериальных активов.

Почему HealthOS? HealthOS – это операционная система, обеспечивающая унификацию процессов создания и совместного использования доверенных цифровых двойников в медицине. Примеры доверенного цифрового двойника в HealthOS: лечебный процесс, например, прогноз и купирование фибрилляции и трепетания предсердий; патогенез системы организма, например, электрокардиография сердечно-сосудистой системы и пр.

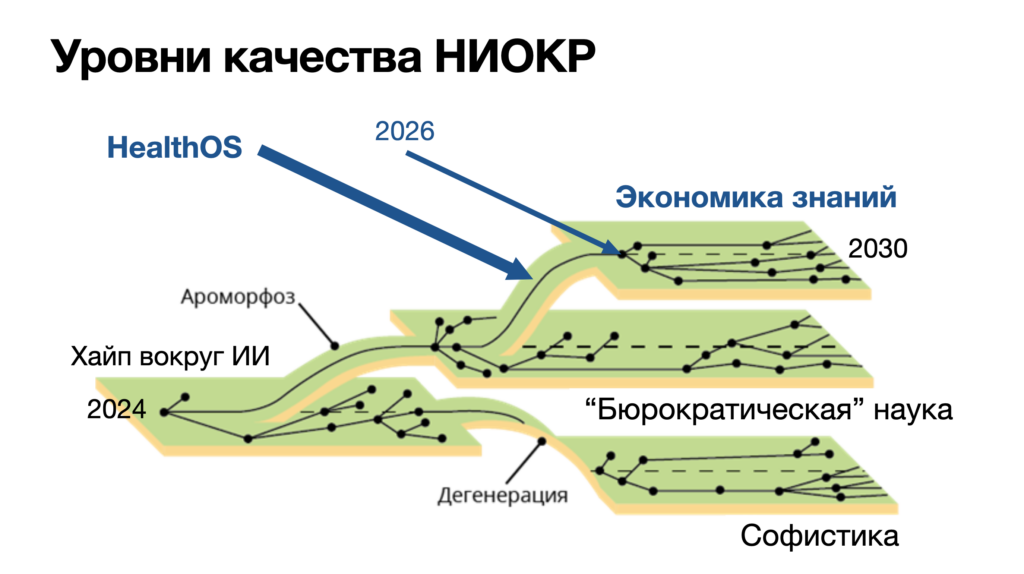

Эволюция качества исполнения НИОКР

Отправная точка — 2024 год, ситуация «хайп вокруг ИИ». Описаны три возможные сценария изменения ситуации в течение ближайших 6 лет. Этические принципы, методики и технологии, лежащие в основе HealthOS, направлены на реализацию сценария «Экономика знаний».

Сценарий «Софистика»

В учении древнегреческих софистов в дискуссии для достижения своих целей применялись манипулятивные техники подмены понятий. Современные исследователи-софисты активно развивают техники риторики и аргументации, основанные на логических уловках и подмене понятий. Это необходимо для манипуляции вниманием аудитории и достижения своих целей. ИИ используется исследователями-софистами для автоматизации и повышения эффективности манипуляций и подмены понятий.

Сценарий «Бюрократическая наука»

В теории, бюрократия в науке — это система управления, осуществляемая управленческим аппаратом, состоящим из должностных лиц, обладающих специальной профессиональной подготовкой и действующих в рамках полномочий в соответствии с формальными правилами. Бюрократия осуществляет селекцию научных исследований на основе «легитимного» свода тем исследований и правил участия в их финансировании. Бюрократия влияет на результаты исследований через контроль тем исследований и правил их финансирования, ограничивая тем самым свободу и творчество учёных, а также замедляя процесс исследований из-за необходимости соблюдения формальностей и сложных бюрократических процедур. Вместе с тем, бюрократия может быть полезной для поддержания порядка и строгого следования планам финансирования исследований.

Сценарий «Экономика знаний»

Экономика знаний — это этап развития постиндустриальной экономики, в котором знания становятся ключевым фактором производства и рыночным товаром. В экономике знаний кодифицированные знания становятся важнейшей составляющей экономического взаимодействия. Стоимость рыночного товара — кодифицированных знаний, может определяться на бирже. Основными характеристиками экономики знаний являются: значительная роль высоких технологий и инноваций в промышленности; повышение качества жизни общества при сниженных трансакционных издержках; производство новых кодифицированных знаний, поставленное на поток.

Кодифицированный товар — это товар, который имеет чёткую структуру и назначение, и может быть применён в конкретной области производства в строго ограниченных условиях. В экономике знаний кодифицированные знания становятся важнейшей составляющей экономического взаимодействия. Они представляют собой набор гарантированно проверенных и надежных сведений, который может быть использован в конкретной области науки или производства в строго ограниченных условиях и имеет высокую стоимость как товар с определенным уровнем качества.

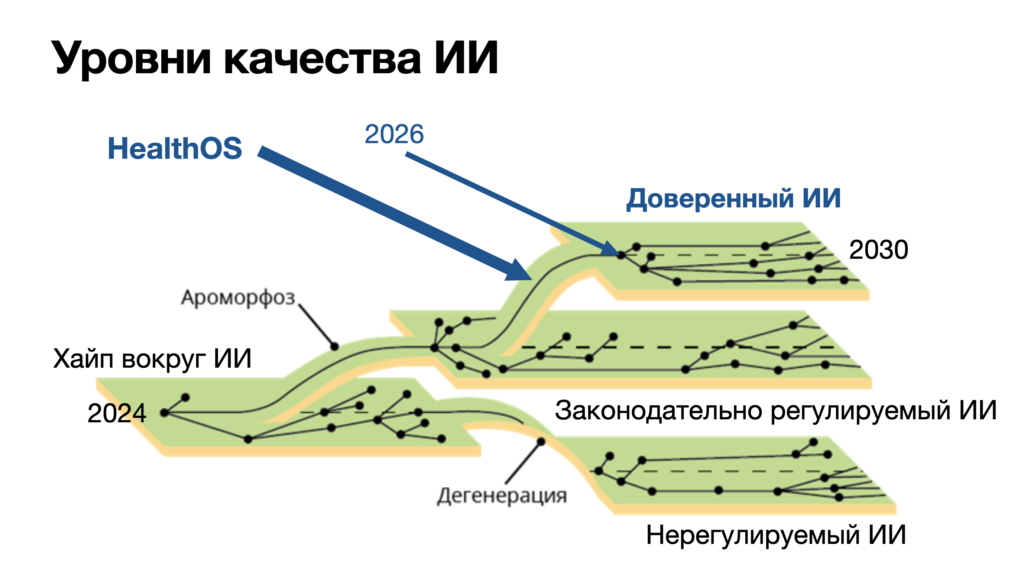

Эволюция качества результатов работы ИИ и доверия этим результатам

Отправная точка — 2024 год, ситуация «хайп вокруг ИИ». Описаны три возможные сценария изменения ситуации в течение ближайших 6 лет. Этические принципы, методики и технологии, лежащие в основе HealthOS, направлены на реализацию сценария «Доверенный ИИ».

Сценарий «Нерегулируемый ИИ»

Нерегулируемый ИИ — это система ИИ, которая не имеет сквозного контроля при использовании, а так же регулирования со стороны какого-либо этического комитета или свода этических правил при обучении и настройке. Основные риски нерегулируемого ИИ. Нежелательное поведение, которое может привести к негативным последствиям, таким как политическая предвзятость или некорректное сексуальное поведение. Непрозрачность и непредсказуемость результатов, что может привести к неправильному использованию или неправильному пониманию результатов работы ИИ. Угроза безопасности, так как ИИ может быть использован для создания вредоносного программного обеспечения или для проведения кибератак. Низкая актуальность или ограниченная полезность из-за отсутствия регулярного обучения или взаимодействия с новыми данными внешнего мира, что снижает его адаптивность к изменяющимся условиям. Неэтичность, что может привести к социальному напряжению, неправильному использованию или неправильному пониманию его работы. Доверие к результатам работы нерегулируемого ИИ не приемлемо.

Сценарий «Законодательно регулируемый ИИ»

Законодательно регулируемый ИИ — это система ИИ, которая регулируется законодательством. В Европейском союзе, например, существует Регламент об искусственном интеллекте, который направлен на создание общей нормативно-правовой базы использования ИИ. Он классифицирует приложения ИИ на три класса, в зависимости от уровня риска вреда пользователю. Законодательно регулируемый ИИ направлен на обеспечение безопасности и этичности использования ИИ, однако он содержит риски. Основные риски законодательно регулируемого ИИ. Возможно ограничение инноваций, так как требуется соблюдение формальных правил и стандартов. Недостаточная гибкость и неспособность адаптироваться к изменяющимся условиям и требованиям рынка. Высокие затраты на разработку и внедрение, что может быть недоступно для некоторых приложений и организаций. Недостаточная прозрачность и непредсказуемость, что может привести к неправильному использованию и неправильному пониманию работы ИИ. Доверие к результатам работы законодательно регулируемого ИИ — возможно с ограничениями.

Сценарий «Доверенный ИИ»

Доверенный ИИ гарантирует прозрачность и доверие путём предоставления информации о его работе, алгоритмах, происхождении и качестве данных, на которых он проходил обучение. При разработке разработчики опираются на этические принципы и права пользователя, чтобы гарантировать, что ИИ не будет использоваться для неэтичных целей или причинения какого-либо ущерба пользователям. Доверенный ИИ может быть проверен и сертифицирован независимыми организациями, чтобы повысить уровень доверия к его надежности и соответствии стандартам. Доверие к результатам работы доверенного ИИ — возможно.

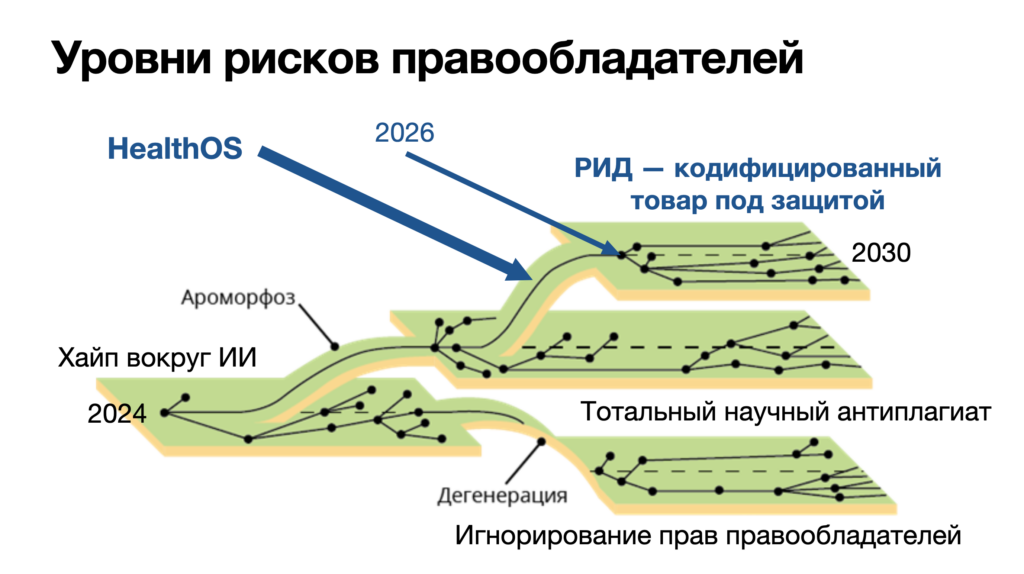

Эволюция рисков правообладателей РИД и других нематериальных активов

Отправная точка — 2024 год, ситуация «хайп вокруг ИИ». Описаны три возможные сценария изменения ситуации в течение ближайших 6 лет. Этические принципы, методики и технологии, лежащие в основе HealthOS, направлены на реализацию сценария «РИД — кодифицированный товар под защитой».

Сценарий «Игнорирование прав правообладателей»

Игнорирование прав правообладателей со стороны генеративного ИИ — это ситуация, когда ИИ создает новый контент, который в том или ином объёме нарушает права интеллектуальной собственности. Это происходит в случае, когда генеративный ИИ не учитывает права правообладателей и создает контент с нарушением прав интеллектуальной собственности. В этом случае правообладатели сталкиваются с проблемами, связанными с нарушением их прав и возможной потерей или недополучением доходов.

Сценарий «Тотальный научный антиплагиат»

Тотальный научный антиплагиат — это государственная автоматизированная система, которая используется для проверки статей, диссертаций, докладов и иных научных работ или документов на наличие заимствований из уже опубликованных научных или открытых документов. Использование такой системы рекомендовано Советом по координации управления качеством профессионального образования при Рособрнадзоре в качестве автоматизированного средства борьбы с плагиатом для совершенствования внутреннего контроля качества индивидуальных работ обучающихся, а также в рамках внедрения типовой модели системы качества образовательного учреждения. Тотальный научный антиплагиат помогает правообладателям защититься от генеративного ИИ, так как он позволяет выявлять неправомерные заимствования и предотвращать нарушение прав интеллектуальной собственности. Однако он содержит риски. Основные риски тотального научного антиплагиата. Недостаточная гибкость централизованной государственной автоматизированной системы и её слабая адаптивность в изменяющихся условиях и требованиях рынка кодифицированных знаний. Значительные затраты на разработку и внедрение тотального научного антиплагиата, что осложняет обеспечение глубины тематического покрытия. Недостаточная прозрачность и предсказуемость, что может привести к неправильному использованию и неправильному пониманию работы тотального научного антиплагиата.

Сценарий «РИД — кодифицированный товар под защитой»

РИД — кодифицированный товар — это результат интеллектуальной деятельности, который имеет чёткую структуру и назначение, и может быть применён в конкретной сфере науки или производства в строго ограниченных условиях. Он представляет собой набор проверенных и надежных сведений, который может быть использован в конкретной сфере науки или производства и имеет высокую стоимость как товар с гарантированным уровнем качества. Защита РИД может быть реализована путём предоставления автоматической правовой охраны объектов интеллектуальной собственности таким образом, чтобы правообладатели могли контролировать использование и распространение своих объектов интеллектуальной собственности путем сквозного аудита их использования в любой момент времени по своему требованию. Это может быть реализовано путём автоматического предоставления прав на использование таких объектов, включая возможность запрета использования указанных объектов другим лицам, если такое использование не нарушает прав других правообладателей. Таким образом, среда использования объектов интеллектуальной собственности обеспечивает автоматическую охрану прав правообладателей и предотвращение нарушения прав интеллектуальной собственности.

Статья создана с помощью большой языковой модели. Для получения консультаций по работе Виртуальной лаборатории — пишите на sales@rtlab.ru, указав в письме «Консультация по использованию Виртуальной лаборатории».